As informações falsas geradas pelo ChatGPT a respeito de um radialista resultaram em um processo contra a OpenAI nos Estados Unidos. A ação, aberta na segunda-feira (5) em um tribunal da Geórgia, acusa a desenvolvedora de difamação e pede indenização.

O caso envolve o apresentador de rádio Mark Walters, que, em um relatório gerado pelo chatbot, é citado em uma acusação de fraude e desvio de dinheiro de uma organização sem fins lucrativos. No entanto, Walters nunca foi denunciado por esses crimes, ou seja, a inteligência artificial (IA) inventou a informação.

Esses detalhes foram gerados pelo robô virtual em resposta à solicitação de resumo de um processo judicial real feita a pedido do jornalista Fred Riehl. Ao resumir o caso, a ferramenta citou dados verdadeiros, mas também incluiu mentiras, já que a ação em questão nem mesmo tem a ver com o radialista ou a apropriação indevida de fundos.

As IAs já foram flagradas gerando informações falsas em várias ocasiõesFonte: Getty Images/Reprodução

As IAs já foram flagradas gerando informações falsas em várias ocasiõesFonte: Getty Images/Reprodução

Apesar de apresentar o ChatGPT como uma fonte confiável, capaz de ajudar o usuário a "aprender algo novo", a OpenAI também diz que o mecanismo não é infalível. Há um alerta, na tela inicial do chatbot, apontando que o sistema "pode ocasionalmente gerar informações incorretas".

Como lembra o The Verge, a legislação americana protege as empresas de internet em relação a informações produzidas por terceiros e hospedadas em seus domínios. Porém, não se sabe se a lei pode ser aplicada à IA, que tem a capacidade de gerar novas informações.

Para o especialista em Direito da Universidade da Califórnia, Eugene Volokh, a acusação de difamação contra a OpenAI é "legalmente viável", a princípio. Mas ele tem dúvidas sobre a vitória do autor, que não teria notificado a empresa, dando a chance da retirada dos dados falsos. Além disso, Walters precisará provar que foi realmente prejudicado pela fake news.

Fonte: The Verge

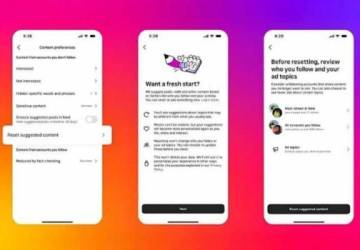

Tecnologia Instagram vai permitir reiniciar o algoritmo para esquecer suas informações

Tecnologia Instagram vai permitir reiniciar o algoritmo para esquecer suas informações  Tecnologia Vídeo: Robô chinês lidera rebelião e incentiva colegas a abandonarem seus postos

Tecnologia Vídeo: Robô chinês lidera rebelião e incentiva colegas a abandonarem seus postos  ESTUDO ESTUDO | Infoblox Threat Intel identifica novos hackers de DNS ligados ao sequestro de domínios Infoblox Threat Intel identifica novos hackers de DNS ligados ao sequestro de domínios

ESTUDO ESTUDO | Infoblox Threat Intel identifica novos hackers de DNS ligados ao sequestro de domínios Infoblox Threat Intel identifica novos hackers de DNS ligados ao sequestro de domínios